近年では、静止画を動画のように動かす技術が注目されています。これはAnimateDiff(アニメイトディフ)などのAIサービスを使って生成されたものです。

すでにSNSなどでAnimateDiffによって生成されたコンテンツなどを見て、興味を示している人も多いでしょう。しかし、

- AnimateDiffとはどのようなツールなのか知りたい

- 始め方を知りたい

- 使い方のポイントや注意点を知りたい

といった疑問を持っている人は多いでしょう。結論から言うと、AnimateDiffはStable Diffusion(ステーブルディフィージョン)の拡張機能のひとつで、静止画から動画を生成できます。

そこで本記事では、AnimateDiffの概要や特徴、使い方などを解説します。AnimateDiffに興味がある人はぜひ参考にしてください。

AnimateDiffとは?概要や仕組みを解説

まずはAnimateDiffの基本を理解するため、以下の点を解説します。

- AnimateDiffの概要

- AnimateDiffのしくみ

- 実際の出力結果

AnimateDiffの概要

Animateは独立したサービスではなく、画像生成AIのStable Diffusionをベースに開発された追加機能です。冒頭でも述べたとおり、静止画から動画を生成します。

実写動画→アニメ動画へ変換生成

— 木村修也【ChatGPT ✖ 最新AI情報】 (@syuyakimura) June 23, 2024

AnimateDiffやComfyUIとかMusePoseみたく構築の手間やチラつきもなく、DomoAIの代替と呼ばれるGoEnhanceも悪くないですが、リアルタイム処理やフレーム間の一貫性の面でDomoAIは優れてる#AI動画 #動画生成AIpic.twitter.com/VHYPWbw8HX

AnimateDiffの開発には2つの大学と1つの団体が関わりました。スタンフォード大学と香港中文大学、そしてAI開発に秀でる上海AIラボが参画しています。

世界的に有名な技術者たちが開発したこともあり、AnimateDiffは非常に高性能だと評価されています。

上動画のように、元々が画像だとはわからないほど自然に動き、いわゆるフレームの崩壊や動作の矛盾などが見受けられません。

またAnimateDiffは個人利用のみならず商用利用も認めており、ビジネスで活用できる可能性も秘めています。

操作もわかりやすく、誰でも簡単にアウトプットを得られるのが魅力です。

実際にAnimateDiffからアウトプットされた動画を見れば、その凄さがわかるでしょう。

AnimateDiffのしくみ

AnimateDiffに関してはどのようにして静止画が動いているか不思議に思っている人も多いでしょう。具体的には以下のしくみを総合して、このような操作を実現しています。

- Stable Diffusionに対して、U-netという「プラグイン」を挿入する

- U-netに用いて、画像に含まれるノイズを予測する

- ノイズ予測に基づき、次のコマを作る

- コマを大量につなぎあわせて、静止画を動画にする

現在はネットミームとなった画像を動画化して、話題の一つとするような使われ方をするのがほとんどです。

詳しく解説すると複雑な数学式が出てくるのですが、やっていること自体はシンプルです。

1枚の絵の次のコマのデザインを考え、その次のデザインも考える。それらを紙芝居形式でつなぎ合わせて、あたかも動画のように見せているわけです。

旧来のアニメーションの制作方法などと比較して違いありません。

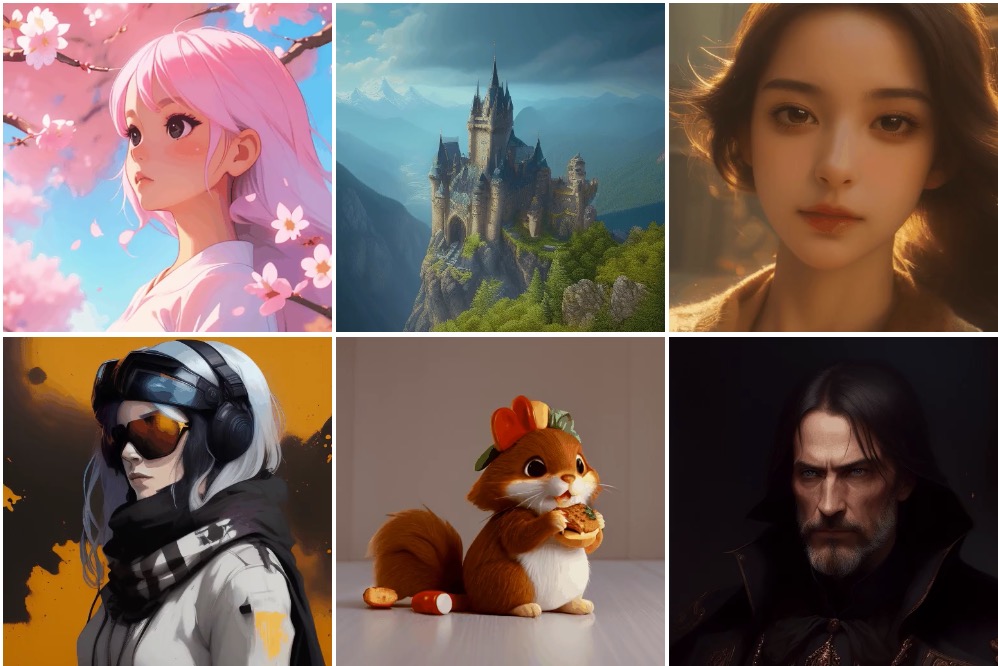

実際の出力結果

AnimateDiffを利用すると、たとえば以下のようなコンテンツが出力されます。

Abstract motion#AnimateDiff #ComfyUI #AIart pic.twitter.com/c5RasLx60t

— NOT REALLY HUMAN (@NotHumanReally) April 29, 2024

comfyui tooncrafter+ animatediff!#aiart #comfyui pic.twitter.com/33jvFUw5G9

— DREX (@Drex1165890669) June 2, 2024

*AIでSakana🐟: AI生成3D素材+VRoid→AnimateDiffで2D変換#Unique3D #ComfyUI #AnimateDiff pic.twitter.com/qvR6CrkzrR

— Baku (@bk_sakurai) June 23, 2024

一部は別のツールを組み合わせて、さらに奥行きや自然さを表現しています。かつては数秒程度の動画しか作れませんでしたが、現在では3分を超える再生時間の動画を生成しているケースも。

ただし、AnimateDiffはまだ「Web上の遊びの一つ」の域を出ていません。今のところAnimateDiffをビジネスで本格利用した事例はほとんどありません。

とはいえ、これだけ長尺かつ自然な動画を生成できるなら、近いうちにAnimateDiffのアウトプットを広告クリエイティブで活用するなどの戦略も成立しうるでしょう。

なおAnimateDiffに関するより詳細かつ技術的な解説は、AI技術者のマーベリック氏のWebサイトで示されているので、興味がある人は参考にしてください。

AnimateDiffの簡単な導入方法と使い方【4STEP】

続いてAnimateDiffの導入方法と使い方を解説します。

- Stable Diffusionを立ち上げる

- Install from URLに入る

- 必要なURLをクリップボードに移す

- AnimateDiff専用のモーションモジュールを導入する

AnimateDiffの導入方法としては、おそらくこれがもっとも簡単です。それぞれのステップを解説するので参考にしてください。

Stable Diffusionを立ち上げる

まずはStable Diffusionを立ち上げます。

Stable Digffusionをインストールしていない場合、以下の記事を参考にしてください。

Stable Diffusionをインストールしていない、もしくは画像生成AIを使ったことがないのなら、上記URLを参考にしつつ、ゆっくりと取り組みましょう。

なおStable Diffusionを含んだブラウザサービスなどでは、AnimateDiffを利用できないので注意してください。

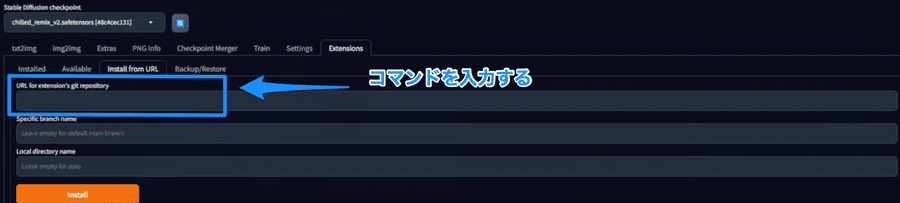

Install from URLに入る

Stable Diffusionが立ち上がったら、続いて、メニューのExtensionを選択して、そのあとでInstall from URLにアクセスします。

必要なURLをクリップボードに移す

続いて、AnimateDiffをインストールするためのコマンド(URL)を入力します。

https://github.com/continue-revolution/sd-webui-animatediff.git

上記コマンドを、下図青枠内に挿入し、最後にInstallをクリックします。

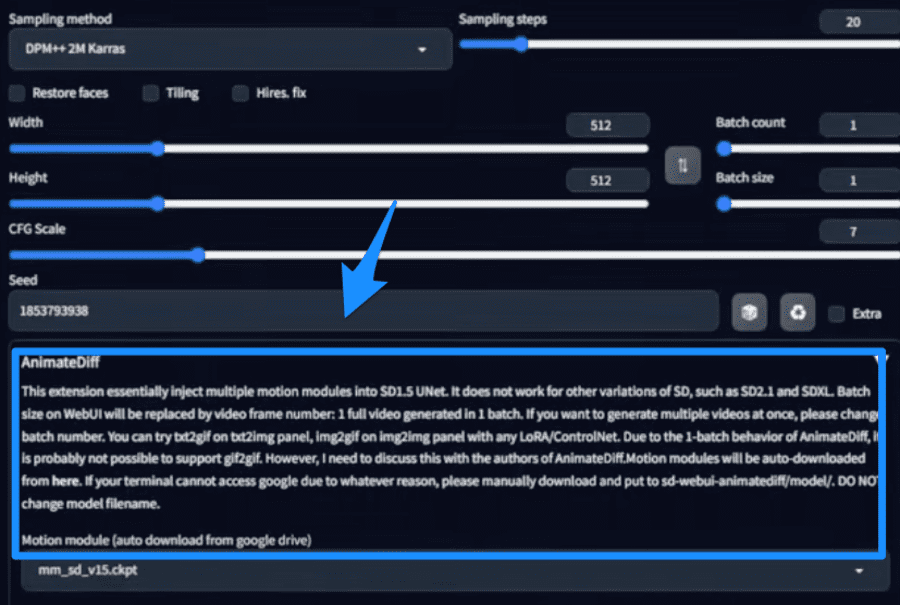

ここまで操作すると、TXT2lmgタブにAnimateDiffが追加されているはず。これでStable Diffusionに、AnimateDiffがインストールされました。

AnimateDiff専用のモーションモジュールを導入する

AnimateDiffは静止画を動画に変換しますが、これにはモーションモジュールが必要です。

Stable Diffusionの画像生成に動きを追加するための拡張機能。

特に問題がなければ、AnimateDiffをインストールする段階で、モーションモジュールも同時に追加されています。

しかし、一部のケースで追加がなされない様子。

モーションモジュールを手動で追加する手順はやや複雑です。しかし、以下の動画を参考にすれば、比較的容易にインストールできます。

うまくいかなかった場合はこのようにしてモーションモジュールを追加しましょう。これがないと機能しないので注意してください。

AnimateDiffが動かない場合の対処方

ここからはAnimateDiffが動かない場合の対処方について解説します。お困りの方は参考にしてください。

- AnimateDiffが正しく機能しない時|xformersを削除

- いつまで経っても動画が生成されない際の対処法

AnimateDiffが正しく機能しない時|xformersを削除

AnimateDiffが正しく機能しない場合「stable-diffusion-webUI」フォルダ内にある、「webui-user.bat」の中の「xformers」を削除するのが有効とされています。

これを削除するだけで、たいていのエラーは解決するとのことです。

何か問題が起こったらとにかくxfomersの状態をチェックし、有効になっているなら消してしまいましょう。

いつまで経っても動画が生成されない際の対処法

この原因は大きく分けてふたつ考えられます。

- 一時的な不具合

- プロンプトが複雑かつアウトプットの容量が重い

まず、ほとんどの場合で一時的な不具合が考えられます。このほとんどは、Stable Diffusionを再起動するなどすれば解決します。

一方で、プロンプトが複雑かつアウトプットの容量が重いときは、どうしても時間がかかります。したがってプロンプトを単純化する、フレーム数を減らすといった対策が必要となるでしょう。

また、AnimateDiffはそれなりに高いスペックを要求しており、古いパソコンを使っていると、生成速度は低くなりがちです。

とはいえ操作方法を間違えておらず、最低使用条件をクリアしているなら、生成できないわけではありません。

なおWeb UI起動時に以下のコマンドを使用すると、処理速度が向上するという情報もあります。

「python launch.py –no-half-vae –opt-sdp-attention –opt-sdp-no-mem-attention」

どうしても速度に不満があるなら、このようなコマンドを入力してみましょう。

AnimateDiff利用時のポイントと注意点

AnimateDiffは、特別な技術がなくても簡単に利用可能です。無料かつ商用利用も認められているため、広告運用などでも活用できます。

ただしAnimateDiffを利用する際、よりよいアウトプットを得ながらも、安全に活用するため、以下の点に関して留意してください。

- 適切なプロンプトを入力する

- 著作権・肖像権侵害に注意する

- 詳細設定を正しく理解する

適切なプロンプトを入力する

AnimateDiff本来のパフォーマンスを引き出すには、まずプロンプトをきちんと考案して入力するようにしましょう。

プロンプトが適切でないと、思ったとおりのアウトプットが得られないからです。

よりよい指示を与えるには、以下の点を意識しましょう。

- プロンプトは、できるだけ詳細なものにする

- 一方で長すぎず、短すぎずを意識する

- 「可愛い」「格好よい」など、主観的な表現を避ける

- 数字で指定できるなら、できる限りそのようにする

こうしたルールを守るだけでもプロンプトが正確になり、よりよいアウトプットが得られます。

また動画生成における有効なプロンプトに関してはすでに実例が公開されています。たとえば動画編集ソフトFimoraの公式メディアでは、クリエイティブな動画生成プロンプトを参照可能。

これを多少調整することで、よりよいプロンプトを得られます。ぜひ一度試してみましょう。

さらに、ChatGPTを利用したプロンプト生成の効率化を提唱するユーザーなどもいます。

Stable Diffusionで使えるプロンプトについては、以下の記事で詳しく解説しているので、参考にしてください。

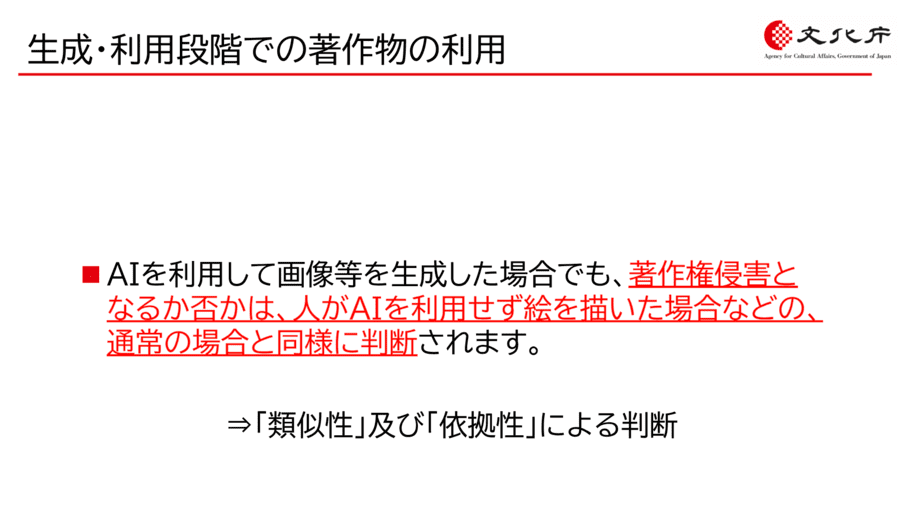

著作権・肖像権侵害に注意する

AnimateDiffを利用する際は著作権と肖像権の侵害に注意してください。

すでに存在するキャラクターや人物の画像を動画にして、商用利用した場合、当然ながら各種権利を侵害することとなります。

まだAnimateDiffに絡んだ民事訴訟の事例が出たわけではありません。

ただ、著作権や肖像権の法律としての建て付けを参照にする限り、このような使い方は権利の侵害に該当すると思われます。

したがって著作権や肖像権などを侵害しないよう、オリジナルの画像を元データとして使う必要があるでしょう。

AnimateDiffは商用利用を認めてはいるものの、それが著作権フリーになったという意味でない点に注意してください。

詳細設定を正しく理解する

また詳細設定を正しく理解するのも重要です。AnimateDiffでは以下のような設定項目があり、これらをうまく活用すれば、より精度の高い生成結果が得られます。

- Number of frames/使用するフレームの総合枚数

- Frames per seconds(FPS)/1秒間に画像が動く回数

- Motion Modlue/使用モデル選択

- Display loop number/生成した動画のループ回数

- Hires fix/画像を高解像度にする

etc.

もっとも重要なのは、Number of framesやFrames per secondsなどの項目。この値が高いほど、より自然かつなめらかに動くアウトプットが得られます。

また、スペックや時間が必要になるものの、単純に解像度をアップさせるHire fixも便利。

そのほかにもContext batchやcontrastなど、さまざまな詳細を設定することが可能です。

設定を細かく触ってみて、どうすればよいアウトプットが得られるか、探っていくとよいでしょう。最初のうちはフレーム数を増やすのがおすすめです。

AnimateDiffに関するよくある質問

本記事ではAnimateDiffに関して詳しく解説しました。ここではよくある質問に回答します。

- AnimateDiffを利用する上で必要なStable Diffusionのバージョンは?

- AnimateDiffは商用利用できますか?

- AnimateDiffの代わりになるツールはありますか?

- AnimateDiffを利用する上で必要なStable Diffusionのバージョンは?

-

AnimateDiffを正常に動作させるためには、Stable Diffusion WebUIのバージョン1.5.0以降が必要で、安定性を重視するのであればバージョン1.5.2が推奨されています。

また、AnimateDiffを使用するには、12GB以上のVRAMを持つGPUが必要で。RTX 4070 TiやRTX 3090などの高性能なグラフィックボードが推奨されます。

- AnimateDiffは商用利用できますか?

-

AnimateDiffから得られたアウトプットは基本的に商用利用可能です。特別に「商業目的で利用してはならない」という禁止事項はありません。

ただし意図しない形で著作権を侵害するなどのリスクはあります。

文化庁は、AIで生成した画像などに関して、「AIを採用せず人が描いた絵などと同様の責任が生じる」という趣旨のリリースを発表しています。

出典:文化庁 すなわち、AnimateDiffを利用する場合でも、著作権の侵害に関しては十分な注意が必要です。こと、インターネット上に存在する静止画を活用できる事実から、肖像権を侵害するリスクも。

AnimateDiffを法人運用する場合は、リーガルリスクに関してもきちんと想定しておく必要があります。 - AnimateDiffの代わりになるツールはありますか?

-

AnimateDiffの代替サービスとして「Creative Reality Studio」などが挙げられます。

これを利用すれば、AnimateDiff同様に、静止画から動画を生成することが可能です。

ただし表現の豊かさという面では、AnimateDiffのほうがすぐれています。特に背景の流れ方などには大きな差があると感じられるでしょう。

したがってクオリティを重視する限りは、AnimateDiffの利用を推奨します。

まとめ

本記事ではAnimateDiffに関して解説しました。最後に重要なポイントをおさらいしましょう。

- AnimateDiffは静止画を動画に変える生成AIツール

- Stable Diffusion上で機能するため単体では利用できない

- きわめて自然な動画を数分以上の尺で出力できる

- まだビジネス事例は限られているが今後は広告クリエイティブなどで活用できる可能性がある

- プロンプトを適切に入力し、詳細設定を正しく理解して活用するのが大切

- 同様のツールは存在するが、今のところAnimateDiff以上のクオリティではない

AnimateDiffはすでに多くのユーザーから注目されています。

今はまだユーザー間での「遊び」で活用されている状態ですが、今後研究が進めば、本格的にビジネス分野で活用されるかもしれません。

今のうちからツールを研究しておくことで、一足早くAnimateDiffを用いたマーケティングや広告活動を展開することも可能でしょう。